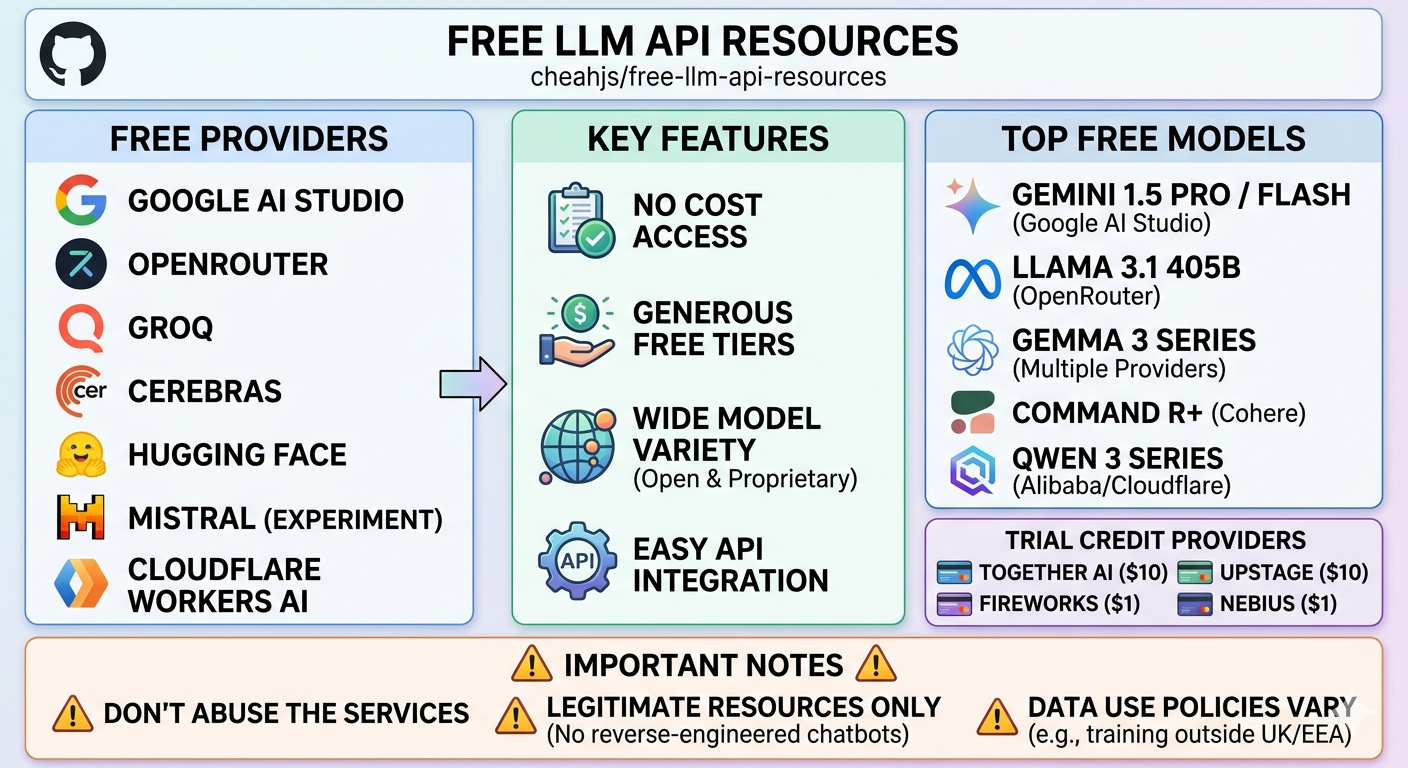

今天发现一个 Github 宝藏项目:free-llm-api-resources。它是一个免费 LLM API 资源列表,汇总了可以免费访问的 AI 模型资源,涉及各种规模,甚至包括 400B+ 参数的巨型模型。

⚠️ 使用过程中注意保护个人数据

1. 免费提供商列表

1.1 OpenRouter

- 限制:20 请求/分钟,50 请求/天(可通过 $10 终身充值提升至 1000 请求/天)

- 支持模型:

- Hermes 3 Llama 3.1 405B(4050亿参数)

- Llama 3.3 70B Instruct(700亿参数)

- google/gemma-4-26b-a4b-it(260亿参数)

- nvidia/nemotron-3-super-120b-a12b(1200亿参数)

- openai/gpt-oss-120b(1200亿参数)

1.2 Google AI Studio

- 数据使用:在欧盟/欧洲经济区/瑞士/英国之外使用时,数据可能用于训练

- 主要模型:

- Gemini 3 Flash:250,000 token/分钟,20 请求/天

- Gemma 3 27B Instruct:15,000 token/分钟,14,400 请求/天

- Gemma 3 12B Instruct:15,000 token/分钟,14,400 请求/天

1.3 NVIDIA NIM

- 要求:需要手机号验证

- 限制:40 请求/分钟

- 特点:上下文窗口有限,支持各种开源模型

1.4 Mistral

- 免费层:需要选择加入数据训练,需要手机号验证

- 限制:1 请求/秒,500,000 token/分钟,1,000,000,000 token/月

- 支持模型:开放和专有的 Mistral 模型

1.5 Groq

- 支持模型:

- Llama 3.3 70B:1,000 请求/天,12,000 token/分钟

- openai/gpt-oss-120b:1,000 请求/天,8,000 token/分钟

- qwen/qwen3-32b:1,000 请求/天,6,000 token/分钟

1.6 Cerebras

- 支持模型:

- gpt-oss-120b:30 请求/分钟,60,000 token/分钟

- Llama 3.1 8B:30 请求/分钟,60,000 token/分钟

1.7 Cloudflare Workers AI

- 限制:10,000 神经元/天

- 支持模型:

- @cf/nvidia/nemotron-3-120b-a12b(1200亿参数)

- @cf/openai/gpt-oss-120b(1200亿参数)

- Llama 3.3 70B Instruct(700亿参数)

2. 提供试用额度的服务商

2.1 Fireworks

- 额度:$1

- 支持模型:各种开源模型

2.2 Baseten

- 额度:$30

- 计费方式:按计算时间付费

- 支持模型:任何支持的模型

2.3 Hyperbolic

- 额度:$1

- 支持模型:

- DeepSeek V3 0324

- Llama 3.3 70B Instruct

- deepseek-ai/deepseek-r1-0528

- qwen/qwen3-coder-480b-a35b-instruct(4800亿参数)

2.4 SambaNova Cloud

- 额度:$5(3个月)

- 支持模型:

- Qwen/Qwen3-235B(2350亿参数)

- deepseek-ai/DeepSeek-V3.2

- openai/gpt-oss-120b(1200亿参数)

2.5 Scaleway Generative APIs

- 额度:1,000,000 免费token

- 支持模型:

- Llama 3.3 70B Instruct

- gpt-oss-120b(1200亿参数)

- qwen3-235b-a22b-instruct-2507(2350亿参数)

- qwen3.5-397b-a17b(3970亿参数)

3. 如何选择适合的免费服务

3.1 根据需求选择:

需要最大模型(400B+ 参数):

- OpenRouter:Hermes 3 Llama 3.1 405B

- Hyperbolic:qwen/qwen3-coder-480b-a35b-instruct(480B)

- Scaleway:qwen3.5-397b-a17b(397B)

需要高请求频率:

- Google AI Studio:14,400 请求/天(Gemma 系列)

- Mistral:1 请求/秒

需要大上下文窗口:

- 注意:NVIDIA NIM 等服务的上下文窗口有限

需要多种模型选择:

- OpenRouter:模型种类最多

- GitHub Models:需要 Copilot 订阅

4. 使用建议

4.1 避免滥用

- 遵守每个服务的限制条件

- 不要创建多个账户规避限制

- 合理使用,确保这些免费资源能够长期存在

4.2 性能优化

- 批处理请求:尽可能批量发送请求

- 缓存结果:对重复查询进行缓存

- 错误处理:实现重试机制和优雅降级

4.3 成本控制

- 监控使用量:定期检查 API 使用情况

- 设置限制:在客户端设置请求频率限制

- 备用方案:准备多个服务商作为备用

5. 使用示例

5.1 Python 示例代码:

import requests

import json

# OpenRouter API 示例

def call_openrouter(prompt, model="openai/gpt-oss-120b"):

url = "https://openrouter.ai/api/v1/chat/completions"

headers = {

"Authorization": "Bearer YOUR_API_KEY",

"Content-Type": "application/json"

}

data = {

"model": model,

"messages": [{"role": "user", "content": prompt}],

"max_tokens": 1000

}

response = requests.post(url, headers=headers, json=data)

return response.json()

# Google AI Studio 示例

def call_google_ai(prompt, model="gemini-3-flash"):

import google.generativeai as genai

genai.configure(api_key="YOUR_API_KEY")

model = genai.GenerativeModel(model)

response = model.generate_content(prompt)

return response.text

5.2 环境变量配置:

# .env 文件示例

OPENROUTER_API_KEY=your_openrouter_key

GOOGLE_AI_API_KEY=your_google_ai_key

GROQ_API_KEY=your_groq_key

MISTRAL_API_KEY=your_mistral_key

6. 常见问题解答

Q1:这些服务真的完全免费吗?

A:大多数服务提供有限的免费额度,超过后可能需要付费或等待重置。部分服务如 OpenRouter 提供 $10 终身充值选项。

Q2:400B+ 参数模型的实际性能如何?

A:400B+ 参数模型在复杂推理、代码生成和多语言任务上表现优异,但响应时间可能较长,且对上下文长度有限制。

Q3:如何避免被限流或封禁?

A:

- 严格遵守速率限制

- 不要发送垃圾或恶意内容

- 使用合理的请求间隔

- 监控 API 响应状态码

Q4:这些服务适合生产环境吗?

A:对于非关键任务和小规模应用可以,但对于生产级应用,建议:

- 使用多个服务商实现冗余

- 设置降级策略

- 考虑付费方案以获得更好的 SLA

7. 更新和维护

这个列表会定期更新,但 AI 领域变化迅速,建议:

- 定期查看原仓库更新

- 关注各服务商的公告

- 参与社区讨论获取最新信息

8. 贡献指南

如果你发现新的免费 LLM API 资源:

- 验证服务的合法性

- 确认免费额度详细信息

- 提交 Pull Request 到原仓库

- 保持列表的准确性和实用性

⚠️ 服务条款和限制可能随时变更,使用前请务必阅读各服务商的最新条款和条件