作者:MayhemCode

译者:Carl Cui

今天这篇文章是搬运过来的,发表于 2025 年 12 月 17 日,那时候由 AI 引发的硬件通胀已经持续了几个月。到现在,2026 年 3 月底,消费级硬件的价格不仅没有回落,反而在全面涨价的基础上看不到回调的希望。虽然最近内存价格出现了小幅回调,但是相比 2025 年 9 月,现在的内存价格依然处于历史极高水平:2025 年 9 月份,一根 16G 的 DDR5 台式机内存价格大概在 200 ~ 390 元,现在大约需要 1100 ~ 1600 元。OpenClaw 的火爆,进一步推动了本地部署 LLM 的需求,对于“不想交数据、不想交钱,或者不想等网络”的那群人,本地部署 LLM 永远是一个绕不开的话题。

1. 为什么自托管 AI 是未来

完全依赖云 API 才能使用 AI 的“苦”日子正在结束。以前每月需要 100 美元的 ChatGPT 或 Claude 订阅现在可以在你自己的硬件上运行。本地部署 LLM 可以带来更好的保护隐私、零持续成本,还有对模型的完全控制。

现在开源的大语言模型,特别是 Llama 3、DeepSeek R1 和 Mistral,已经足够处理真实工作。问题在于,你需要知道哪些硬件能把它们跑起来。这篇文章教大家怎么选最具性价比的硬件,不管你准备搭建预算有限的家庭实验室还是高性能的 Proxmox 服务器。

译者注:2025 年 12 月到现在,硬件和 LLM 已经出现了很多变化,文章中的部分内容稍显过时,推荐配置也是当时国外的行情,不过拿来了解 LLM 硬件配置还是值得一读的。

转向本地部署 LLM 不仅仅能节省订阅成本,还能改善数据隐私:执行任务的时候不再需要把数据发送到其他服务器上。另外,本地模型可以做到即时响应,没有延迟,也不会出现高峰期需要排队的情况。运行什么模型、哪个版本完全由自己决定。对于开发者、DevOps 工程师和 AI 爱好者,这些好处值得你在硬件上花钱。

译者注:本文中

LLM与模型表示相同的语义,有的地方是 LLM,有的地方是模型,仅出于个人的表述习惯。

2. 与 AI 相关的硬件主要有哪些

2.1 最重要的因素

在本地部署 LLM 依赖于一些特定的部件,其中最有决定性的是 GPU 的显存 VRAM。

译者注:本文中

显存和VRAM表示相同的语义。

每个 LLM 都保存为一个大文件,比如 Llama-3-7B 模型,在全精度下,大约是 3.5 GB。LLM 必须完全加载到 VRAM 中才能进行合理快速的推理。如果显存不够,LLM 的推理工作需要回退到 CPU 和系统内存,这比在 GPU 上要慢数百倍。这一点也是文章中每个建议配置的出发点。

2.2 GPU(显卡)

GPU 是 LLM 推理的大脑,一切主要取决于显存。毫不夸张的说,显存大约占到 LLM 推理性能的 9 成。

为什么主要取决于显存:当你加载 LLM 时,整个参数文件需要放在 GPU 显存中。对于一个 7B 模型:全 16 位精度时,大约需要 14GB;在 8-bit 量化下需要 7GB;在 4-bit 量化时,大约 3.5GB。如果你的显存容量不足,模型会分散在 GPU 显存和系统内存之间,然后每次参数查询都需要往返于较慢的系统内存,假设本来每秒可以处理 10 ~ 15 个 token,可能就降到了 1 ~ 3 个。不单单是速度变慢了,实际情形中甚至都没办法用。

模型的量化非常重要:现代 LLMs 几乎总是以量化形式部署(降低了精度)。4-bit 模型可以将 VRAM 占用减少到四分之一,同时相比全精度版本 LLM 还能保持不错的质量。8-bit 模型以一倍的 VARM 换取更少的质量损失。对于消费级硬件,4-bit 量化是任何大于 7B 模型的首选。

2.3 根据 LLM 大小和量化级别估算 VRAM 需求

4-bit 量化的 7B 模型大约需要 3.5 ~ 4GB 的 VRAM;在 8-bit 量化下,需要约 7GB;在全 16 位精度下,你需要 14GB(对很多消费级 GPU 来说有点超标)。对于日常对话、推理和编码等任务,预算有限的情况下可以考虑 7B 模型。

更大一些的 13B 参数模型,4-bit 量化大约需要 7GB 的 VRAM,8-bit 需要 13GB,全精度大约 26GB。16GB 版本的 RTX-4060-Ti 就可以轻松运行 13B 模型,也有余地保存上下文和提示缓存。实测表明,13B 模型在中等程度任务上表现良好:文档摘要、更细致的推理和具有上下文感知的代码生成。

30B 参数模型更大一些:4-bit 量化时大约 16GB,8-bit 量化时 30GB,全精度情况下大约 60GB。只有高端消费级 GPU 如 RTX-4090 才能处理这个级别。不过,即便是高端消费级 GPU,仍然会受限于 VRAM 容量的限制。70B 参数模型是对消费级硬件是一个真正的考验:在 4-bit 量化后,70B 模型消耗 35 ~ 40GB 的 VRAM。RTX-4090 最多 24GB,这意味着没有办法将 70B 模型完全加载到 GPU 显存,除非采取极端措施:CPU offloading、跨多个 GPU 对模型分片,或者采用低于 4-bit 的量化(这会显著降低质量)。

DeepSeek-R1 671B 参数模型则处在一个完全不同的级别:全精度需要 1.3TB 的 VRAM。即使采用 4-bit 量化,它也需要 335GB。通过极其激进的量化将其压缩到 1.58-bit,可以将其压缩到大约 131GB,但代价是明显的质量下降(准确率损失 15 ~ 25%)。这是数据中心级别的规模,如果不做极端的妥协,对于消费级硬件来说是不可行的。

2.4 2025 年的实用 GPU 选择

RTX-3060-12GB 仍然是最实惠的入门产品,二手大约 200 ~ 250 美元。它处理完整的 7B 模型和重度量化的 13B 变体。上限很明显:12GB 限制你只能使用小模型或极端量化。如果你想尝试 7B 之上的模型,这张卡就不太够用了。

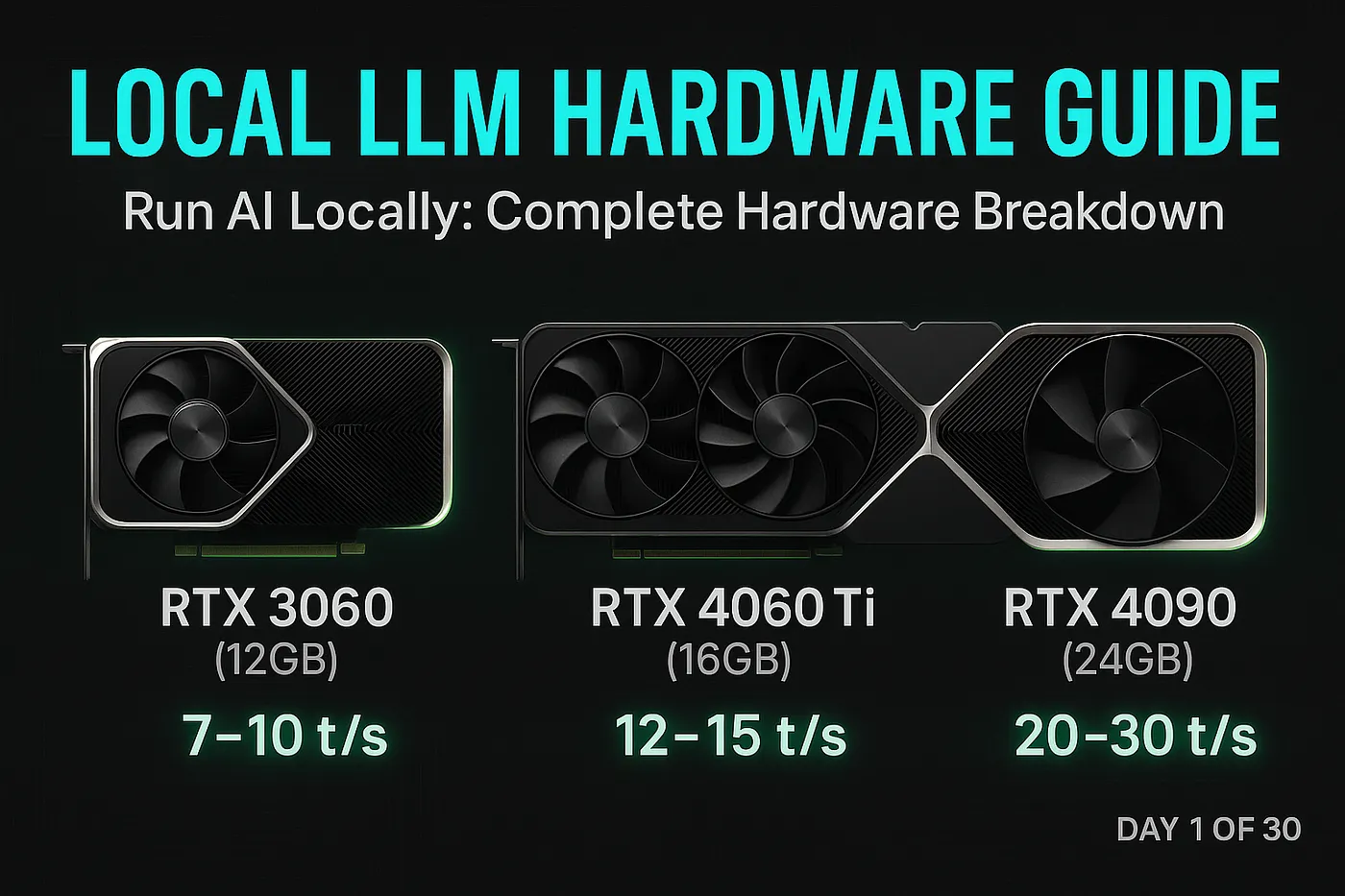

从技术角度来说,RTX-3060 是 2020 年的产品,在 GPU 里中已经算是比较老旧的了,但对于小模型推理来说,它表现不错。运行 Llama3-8B 模型(原文中是 Llama3-7B)时,你可以看到每秒 7 ~ 10 个 token 的推理速度,这对于 AI 爱好者和本地开发者来说完全够用。

RTX-4060-Ti 16GB 版本(全新售价 499 美元,2025 年 7 月开始铺货)发烧友和硬核爱好者的优选。16GB 可以轻松运行 13B 模型,还有空间用于上下文和提示缓存。它的单 GPU 核心性能比3060 快 1.7 倍,功耗仅为 165W,非常适合 7 * 24 小时持续运行。如果有的话,可以花 250 ~ 300 美元淘个二手的。在 Llama-3-13B模型上,它的性能大约能达到每秒 12 ~ 15 个 token,比入门级更快,并且足够流畅,可以用于实际工作。

RTX-4090-24GB 是发烧友级别的配置,全新价格在 1200 ~ 1500 美元之间。它可以在 4-bit 量化下运行 Llama-3-70B 模型,速度可接受(大约每秒 7 ~ 9 个 token,受限于 24GB 显存的限制,需要模型管理)。如果你想要同时运行多个模型或处理更大的上下文窗口,这是最低要求。对于重要的工作,24GB 显存没得商量。实际测试下来,RTX-4090 运行 13B 模型时每秒可以处理 20 ~ 30 个 token,可以吃并发任务或更大的 batch size。

AMD 替代品,如 RX-7800-XT-16GB 和 RX-6800-XT-16GB 以更低成本提供相同的显存容量,但 ROCm(AMD 的 CUDA 等效物)支持仍然不如 NVIDIA 的生态系统成熟。

驱动生态系统正在改进,像 KoboldCpp 和 MLC-LLM 这样的工具现在支持 AMD,但 CUDA 的主导地位意味着 NVIDIA 显卡享有更广泛软件支持和更快的驱动更新。尽管 AMD 对于那些愿意解决 ROCm 怪问题和可能祭出一些尖端优化的人来说表现优异,但是对于第一次配置,NVIDIA 仍然是更安全的选择。

2.5 RAM(系统内存)

系统 RAM 在 GPU VRAM 填满时充当溢出缓存。16GB 确实是最低 RAM 要求;它要处理操作系统、系统开销和基本的上下文。然而,一旦你填满显存并且系统内存成为溢出缓冲区,推理速度就会急剧退化。卸载到系统内存的模型,运行速度大约只有在 GPU 时十分之一。性能损失并非微不足道,它是灾难性的:你将看到每秒只有 1 ~ 3 个 token,而不是 10 ~ 15 个。对于任何重要的 LLM 工作,你不能依赖系统内存作为模型缓存。

译者注:本文中

内存和RAM表示相同的语义。

实际建议:任何认真的配置,最低要求是 32GB 系统内存。在 Proxmox 环境中,你需要在 LLM 推理引擎旁边运行虚拟机,这时 32GB 系统内存变得更加关键。多个虚拟机需要内存,你的 LLM 推理服务需要内存,操作系统需要内存。如果在这里节省内存,你会感觉每一 GB 都得精打细算着用。

64GB 可以将您的配置转变为一个靠谱的多模型平台。两个虚拟机,每个限制在 32GB,加上主机系统的余量,再加上基于内存的缓存来加速你的 LLM,你仍然可以在没有严重资源争用的情况下运行多个服务。

对于使用 CPU offloading 进行 70B 模型推理的情况,64 ~ 128GB 是标准配置。一旦开始运行生产负载或并行测试多个模型,额外的 RAM 投资就能迅速获得回报。

2.6 CPU(处理器)和存储(SSD)

对于 LLM 推理,你的 CPU 出人意料地并不重要。GPU 几乎承担了所有重活。只要 VRAM 容量匹配,Intel-Core-i7 和像 N100 这样的低功耗处理器提供的推理速度基本上是一样的。CPU 重要的地方在于:分词速度(将文本转换为模型可读的标记)和上下文长度。更快的核心能提供些许帮助,但是 CPU 不算瓶颈,不值得过度投资。

即使是较旧的 Ryzen-5-5600X 或者 i5–12400 也足够了。GPU 加速完全压倒了 CPU 性能。除非你同时也在使用那台服务器处理其他工作负载,否则避免将你的 LLM 配置与高端 CPU 搭配。3.5GHz 或更好的四核处理器足够完美地处理分词。你的钱应该投入到 GPU 和 RAM 上,而不是 CPU。

存储比 CPU 更重要。LLM 模型文件很大。一个以 4-bit 形式存在的 70B 模型,是 35 ~ 40GB。多个模型很容易超过 200GB。NVMe SSD 加载这些文件比 SATA SSD 快 5 ~ 6 倍。差异非常明显:NVMe 可以做到 10 ~ 20 微秒延迟和大约 3500 MB/s 的读取速度。

SATA 最高延迟约为 100us,读取速度大约 600MB/s。对于模型加载,NVMe 减少了 30% 到 50% 的初始化时间。如果你在多个模型之间切换或频繁重启服务,NVMe SSD 可以显著改善 SATA 硬盘的糟糕体验。

存储建议:预算够的话,至少要配一个 512GB 的 NVMe 固态硬盘。如果打算用 Proxmox 做实际的多模型场景,那 1TB 的 NVMe 才是比较实际的。具体用哪个型号关系不大,容量更重要。西部数据黑盘 SN850X 和三星 990 Pro 都是比较可靠的选择。如果可以的话,尽量避免 QLC 闪存(每个存储单元存 4 个比特),因为 TLC 闪存(每个存储单元存 3 个比特)在处理 LLM 工作时,能提供更好的持续读写性能,因为你需要反复读取很大的模型文件。

3. 建议配置:从入门到发烧

3.1 Ollama 入门套件(初级:300 ~ 400 美元)

这个配置证明你可以在极低的预算下尝试 LLMs。目标显存 12GB:

- 二手 NVIDIA RTX-3060-12GB GPU,200 ~ 250 美元

- B450/B550 AM4 芯片组主板

- 二手 AMD Ryzen-5-5600X CPU,100 ~ 120 美元,或同等产品

- 32GB DDR4 RAM,80 ~ 100 美元

- 512GB NVMe SSD,50 ~ 70 美元

- 650W 80+ Bronze 电源,60 ~ 80 美元

总成本:新的大约 550 ~ 700美元,如果购买二手更便宜。

适合:业余使用,学习 Ollama,测试 7B 模型,在不进行大量投资的情况下本地玩玩 AI。

性能预期:运行 Llama-3-8B 时,每秒大概处理 7 ~ 10 个 token。量化 13B 模型是可能的,但会比较卡顿。只支持单个模型加载和推理,不支持多模型并发。这只是一个学习用的工具,不是生产系统。

为什么这样配置:RTX-3060-12GB 按 GPU 标准来说已经非常老旧(2020 年发布),但对于小模型来说仍然非常出色。系统内存足以应对单模型工作负载。没有花哨的功能,没有 Proxmox,没有虚拟机:只是一个直接安装的 Ubuntu Server,由 Ollama 掌控全局。你可以初步了解量化技术,并体验不同大小的模型表现。体验上一个月或两个月,你就会明白自己是否需要花钱搞一个更大的系统。

3.2 DevOps 家庭实验室(中档:800 ~ 1200 美元)

可以运行 Proxmox:16GB GPU 加上最少 32GB 系统内存。

- 新 NVIDIA RTX-4060-Ti 16GB 版本,499 美元

- 或二手 RTX-3090,700 ~ 800 美元(二手市场)

- Supermicro X12 系列主板

- 或带有 VT-d/IOMMU 支持用于 GPU 直通的 ASUS ProArt B550

- 二手 AMD Ryzen-7-5800X3D

- 或 Intel i7–12700K CPU,200 ~ 250 美元

- 64GB DDR5 RAM,200 ~ 250 美元

- 1TB NVMe SSD,80 ~ 120 美元

- 850W 80+ Gold 电源,100 ~ 150 美元。

总成本:新的大约 1300 ~ 1800 美元;购买中代二手 GPU 则约 900 ~ 1200 美元。

适合:在 Proxmox 上运行多个虚拟机,同时托管 LLM 服务和其他工作负载,测试基础设施,与 CI/CD 流水线集成。

性能预期:在 4-bit 精度下,Llama-3-13B 每秒处理 12 到 15 个 token。通过虚拟机实现资源隔离,可以同时运行多个 7B 模型。对 30B 模型也能进行量化处理,运行流畅。实际测试表明,这一级别可以同时承载开发环境、监控堆栈和推理服务,而且不会出现令人头疼的资源争用问题。

为什么这样配置:64GB 系统内存将此平台转变为多负载工作平台。Proxmox GPU 直通变得真正实用。你可以在一个虚拟机中运行 13B 模型,在另一个虚拟机中运行开发环境,同时仍能保持系统稳定性。RTX-4060-Ti 的能效(165W)意味着即使 7 * 24 小时运行,电费也合理。这就是你停止捣鼓玩具并开始搭建实际生产工具的配置。你开始认真学习 Proxmox,理解资源分配,并体验生产级虚拟机隔离的工作方式。

3.3 AI 训练动力站(专家:2500+ 美元)

这是为了实际有产出的工作:微调、大模型、生产推理。24GB+ 显存,128GB+ 系统内存,考虑多 GPU。

- NVIDIA-RTX-4090 24GB,1200 ~ 1500 美元

- 或多 GPU 设置,双 RTX-4090 或专业卡如 RTX-6000

- ASUS Pro WS Z790-SAGE UEFI 主板,具有多 PCIe 插槽支持用于多 GPU 场景

- AMD Threadripper 5990WX

- 或 Intel Xeon W5–3435X,500 ~ 1000 美元

- 128 到 256GB DDR5 RAM,600 ~ 1200 美元

- 4TB NVMe SSD(多个驱动器,RAID 0 用于吞吐量),300 ~ 500 美元

- 1600W 80+ Platinum 电源,300 ~ 500 美元

总成本:高端单 GPU 4000 ~ 7000 美元;多 GPU 配置 8000 ~ 15000 美元以上。

适合:生产级 LLM 服务,私有模型微调,研究,高吞吐量推理,多模型并发服务。

性能预期:在 Llama-3-70B 模型上,4-bit 精度下每秒可达 20 至 30 个 token。通过极端量化(1.58–2 位)可实现 DeepSeek-R1-671B 推理,但质量会明显下降。可在私有数据集上微调 13B ~ 70B 模型。通过多 GPU 并行和模型分片策略,可同时推理多个 70B 等价模型。

为什么这样配置:RTX-4090 的 24GB 显存,可轻松容纳 4-bit 量化的 70B 模型。128GB 系统内存支持模型并行化策略:在多个 GPU 之间分片,冗余加载以实现快速模型切换。高核数 CPU(比如Threadripper 的 32 核以上)能加速批量推理的预处理和分词。这套配置,在消费级硬件上就接近数据中心级别的性能了。

此时你不再是在实验,而是正在运行一个推理服务,可以为一个小团队提供服务或成为 API 接入点。

4. 需要用到的软件

运行这些配置中的任何一个,都需要特定的软件。

Proxmox VE 成为你的虚拟化 hypervisor,特别是在中端和专家配置中。它管理虚拟机资源的分配,启用 GPU 透传(在虚拟机中支持原生的 NVIDIA 驱动),并隔离工作负载。裸金属 hypervisors 在 GPU 透传方面需要大量的故障排除;Proxmox 处理得优雅。它是免费的、开源的,并在生产环境中被广泛采用。

Ubuntu Server 是你 Proxmox 虚拟机中的操作系统。它提供最佳的 NVIDIA 驱动程序兼容性、稳定的软件包仓库,以及广泛的 Ollama 支持。CentOS/RHEL 也可以工作,但为业余爱好者引入了不必要的麻烦。Windows 虚拟机也可以工作,但会增加开销和许可成本,除非你有特定的原因,否则跳过它。截至 2025 年,Ubuntu Server 22.04 LTS 是标准版本,提供五年的安全更新。

Ollama 简化了所有事情。它是一个单命令工具,通过 REST API 下载、量化和提供大型语言模型。你不再需要与 llama.cpp、GPTQ 工具或量化框架“纠缠”,你只需运行

ollama pull llama3:13b-q4_K_M,几秒钟后,模型就在localhost:11434上可用。Ollama 隐藏了基础设施的复杂性。在幕后,它正在优化 GPU offloading、管理上下文窗口和处理模型加载,你永远不需要看到这种复杂性。它是原始硬件加速和用户友好推理之间的桥梁。Open WebUI 用类似 ChatGPT 的界面包装了 Ollama。如果你不是以编程方式使用 REST API,Open WebUI 为你提供了一个基于 Web 界面,用于聊天、图像理解和模型切换。它是可选的,但它大大提高了你的网络上的非技术用户的可用性,或在测试不同模型而不进行 API 调用时。

CUDA Toolkit 和 cuDNN 必须在主 Proxmox 系统上安装(版本匹配非常重要)。Proxmox 处理 GPU 驱动程序的安装,但 CUDA 库启用了实际的 GPU 计算。对于 NVIDIA RTX 卡,截至 2025 年,CUDA 12.1+ 是标准配置。较旧的 GPU(RTX 2000/3000 系列)可能需要 CUDA 11.8。版本不匹配是“GPU 未检测到”错误的一个常见来源,在安装前先验证兼容性。特定的版本很重要,错误的组合会浪费数小时进行故障排除。

5. 结论:显存是配置关键

显存(VRAM)是本地 LLM 部署的决定性限制因素。其他所有东西,CPU、内存、存储、软件,都是为了优化显存。12GB 显存的 GPU 将限制你使用 7B 模型以及高度量化的 13B 变体。16GB显存 的 GPU 可以流畅运行 13B ~ 30B 范围的模型。24GB 显存的 GPU 是 70B 模型的入门级。这并非随意而为,而是神经网络工作的物理学原理。内存访问模式对推理延迟的影响远远大于原始计算能力。

你下一步要做的是:根据哪些模型适合你,来确定显存大小。如果你想在本地运行 Llama-3-70B,那 24GB 显存是少不了的。如果你觉得 7B 推理模型的性能就够用了,那买个预算级的 RTX-3060,总共花不到 700 美元就能搞定。如果你想要灵活性和未来扩展,又不想超出,那 2025 年显存性价比最高的就是 RTX-4060-Ti 16GB 版本。

硬件一锁定,Proxmox 的设置就开始了。GPU 透传是裸硬件和生产化基础设施之间的桥梁。这就是这个系列第二天要接手的地方——GPU 透传配置教程,是实现真正本地 AI 独立性的最后一块拼图。

你会从“我有带 GPU 的硬件”转变为“我有一个在隔离虚拟机中运行多个模型的生产级 LLM 服务器”。

原文链接

The Complete Guide to Local LLM Hardware: Specs for Running AI Models on Consumer Hardware